Seit August 2025 verschärft der EU AI Act die Transparenzpflichten für generative KI. Unternehmen stehen zunehmend unter Druck, ihre Systeme zu prüfen und regulatorisch abzusichern. Readiness-Checks helfen dabei, Risiken frühzeitig zu erkennen und strategische Lücken zu schließen. Das gilt uverändert auch und gerade angesichts aktueller Bestrebungen auf EU-Ebene, Vereinfachungen und Erleichterungen zu beschließen.

(Bild: SuPatMaN / Shutterstock. No use without permission.)

(Bild: SuPatMaN / Shutterstock. No use without permission.)

Mit dem Inkrafttreten der nächsten Phase des EU AI Acts im August 2025 steigt für Unternehmen der Handlungsdruck, den Einsatz von Künstlicher Intelligenz strategisch zu planen. Die neuen Transparenz- und Governance-Pflichten betreffen längst nicht mehr nur Entwickler hochkomplexer Systeme, sondern auch viele Anwender, die generative KI in ihre Prozesse integrieren. Wer jetzt noch unvorbereitet ist, riskiert nicht nur Verzögerungen bei Projekten, sondern auch teure Anpassungsschleifen oder gar Bußgelder.

Der EU AI Act, der am 1. August 2024 in Kraft trat, ist die weltweit erste umfassende Regulierung für künstliche Intelligenz. Er verfolgt einen risikobasierten Ansatz und ordnet KI-Systeme in vier Kategorien ein – von inakzeptablen Risiken, die verboten sind, über Hoch- und begrenzte Risiken mit besonderen Auflagen bis hin zu geringen Risiken ohne spezielle Verpflichtungen.

Generative KI und General-Purpose-AI bilden eine eigene Kategorie mit zusätzlichen Transparenzpflichten. Seit dem 2. August 2025 gilt, dass Anbieter dieser Systeme offenlegen müssen, welche Trainingsdaten verwendet wurden, wie mit urheberrechtlich geschütztem Material umgegangen wird und welche Sicherheitsmechanismen integriert sind. Zudem müssen öffentliche Zusammenfassungen der Trainingsdaten bereitgestellt werden. Parallel dazu wurden nationale KI-Behörden benannt und der Europäische KI-Ausschuss nahm seine Arbeit auf.

Für Unternehmen bedeutet dies, ihre KI-Systeme zu inventarisieren, die Risikokategorie zu bestimmen, Transparenzdokumente zu erstellen und Verantwortliche für Compliance zu benennen. Bis 2026 verschärfen sich die Anforderungen, vor allem für Hochrisiko-KI-Anwendungen wie biometrische Systeme, Kreditwürdigkeitsprüfungen oder medizinische Diagnostik. Verstöße können mit Bußgeldern in Millionenhöhe geahndet werden. Eine frühzeitige Standortbestimmung ist daher nicht nur empfehlenswert, sondern strategisch geboten.

Als ein Instrument, Unternehmen Orientierung im komplexen Feld der KI-Integration zu geben, haben sich Readiness-Checks etabliert. Sie ermöglichen eine schnelle Bestandsaufnahme und liefern konkrete Ansatzpunkte für den Einstieg in die KI-Nutzung. Im Kontext des EU AI Acts helfen sie oft zudem, Compliance-Risiken frühzeitig zu erkennen und gezielt zu adressieren. Wir stellen eine Handvoll solcher Checks beispielhaft vor – und beleuchten ihre Grenzen.

Encurio: KI-Check für die Digitalwirtschaft

Ein erst kürzlich gestartetes Beispiel für einen praxisorientierten Online-Check ist der KI-Eignungs-Check der Leverkusener KI-Beratung encurio GmbH Er richtet sich vor allem an Unternehmen aus dem E-Commerce-Umfeld und der Digitalwirtschaft, die ihre Abläufe mit KI optimieren wollen. „Die meisten Onlinehändler vergeuden das Potenzial ihrer Daten. In den E-Commerce-Abteilungen des Landes stecken Mitarbeiter etliche Stunden in Excel-Tabelle. Schuld daran tragen veraltete Prozesse und unüberlegte Software-Nutzung. KI-Lösungen bieten die Chance, mittels Automatisierung wertvolle Arbeitszeit einzusparen und Margen zu optimieren“, lautet die Analyse des encurio-Geschäftsführers Sebastian Rahmel.

Sein KI-Check umfasst technische Grundlagen wie Shop-Funktionalität, Checkout-Prozesse und Zahlungsmethoden ebenso wie die Dateninfrastruktur und deren Qualität. Auch die Fähigkeit, Kennzahlen zu analysieren und daraus Entscheidungen abzuleiten, spielt eine Rolle. Darüber hinaus bewertet der Check die Kompetenzen der Mitarbeiter, den Automatisierungsgrad bestehender Prozesse und die Integrationsfähigkeit unterschiedlicher Systeme.

Das Ergebnis ist ein strukturiertes Bild der aktuellen Situation, verbunden mit konkreten Vorschlägen zur Verbesserung. So kann etwa deutlich werden, dass zwar ausreichend Daten vorhanden sind, diese jedoch nicht in der benötigten Qualität oder Struktur vorliegen. Ebenso kann der Check aufzeigen, dass fehlendes Know-how im Team die Umsetzung bremst oder dass bestehende Systeme nur eingeschränkt miteinander kommunizieren. encurio kombiniert diese Erkenntnisse mit strategischen Handlungsempfehlungen – von gezielten Weiterbildungen über Prozessanpassungen bis zu Investitionen in bestimmte Technologien. Mit diesem Praxisbezug hebt sich das Tool von rein schematischen Multiple-Choice-Tests ab.

KIRC: Niederschwelliger Check für den Mittelstand

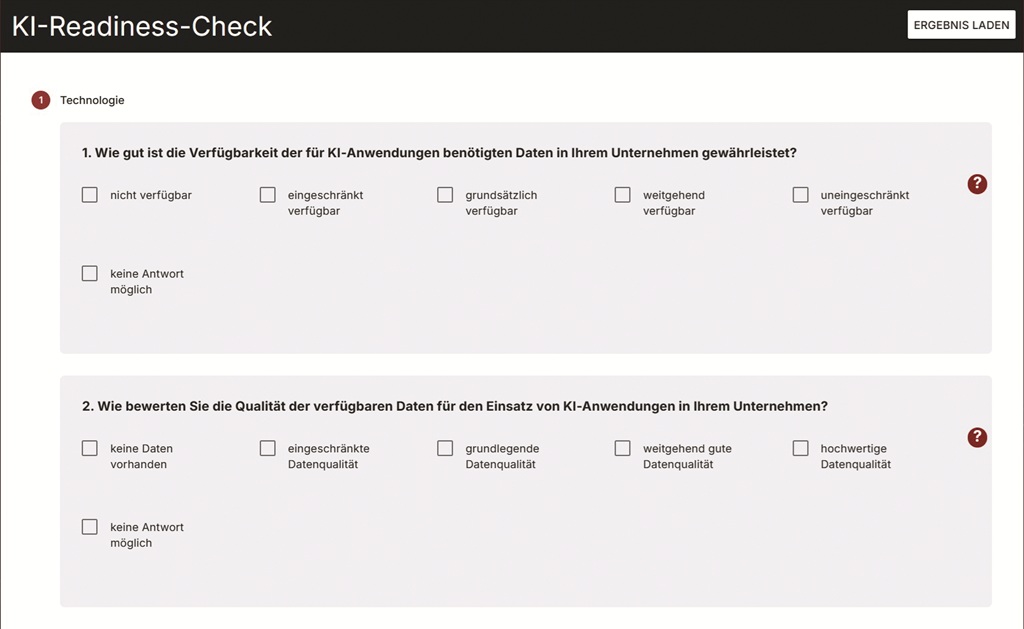

Einen anderen Ansatz verfolgt der KI Readiness Check (KIRC) des Mittelstand-Digital Zentrums Kaiserslautern. Das kostenfreie Tool wurde in Zusammenarbeit mit dem Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) entwickelt und richtet sich gezielt an kleine und mittlere Unternehmen sowie Betriebsräte. Der im Frühjahr 2025 überarbeitete Online-Fragebogen umfasst rund 40 Fragen, gegliedert in die Bereiche Technologie, Organisation, Mitarbeiter und Umwelt beziehungsweise Compliance. KMU können ihre KI-Bereitschaft jetzt gezielter bewerten – kompakter, detaillierter und mit neuen Vergleichsmöglichkeiten.

Die Bearbeitung dauert etwa 20 Minuten, die Auswertung erfolgt sofort. Das Unternehmen erhält eine Einordnung seines Reifegrads auf einer fünfstufigen Skala – vom Novizen bis zum voll entwickelten KI-Anwender – sowie einen Vergleich mit anderen Unternehmen ähnlicher Größe und Branche. Hinzu kommen Empfehlungen für die nächsten Schritte, etwa die Einführung bestimmter Tools, Investitionen in Dateninfrastruktur oder die Qualifizierung von Mitarbeitenden.

Seit der Überarbeitung bietet der Test zusätzlich eine detaillierte Ergebnisseite, die jederzeit per Code abgerufen werden kann. Zudem können Unternehmen ihre Ergebnisse nun direkt mit anderen Unternehmen ähnlicher Größe und Branche vergleichen.

Der KIRC ist besonders für Unternehmen mit geringem Startbudget interessant, die sich einen schnellen, anonymen Überblick verschaffen wollen, ohne gleich externe Beratung in Anspruch zu nehmen.

AI Readinesss Check: Einfacher Selbsttest

Der AI Readiness Check der Leftshift One Software GmbH aus Graz ist ein kostenfreier, interaktiver Online-Selbsttest, der Unternehmen in nur rund zehn Minuten einen ersten Überblick über ihren Stand in Sachen Künstliche Intelligenz verschafft. Der Check ist branchenunabhängig und hat den Anspruch, sich für Organisationen jeder Größe zu eignen– vom Startup bis zum Konzern. In einem kompakten Fragenkatalog werden wesentliche Faktoren abgefragt, die für die erfolgreiche Einführung von KI relevant sind. Dazu gehören strategische Zielsetzungen, vorhandene Ressourcen und Infrastrukturen, internes Knowhow, Datenqualität und die grundsätzliche Offenheit der Organisation für KI-gestützte Arbeitsweisen.

Der Ablauf ist bewusst einfach gehalten: Der Test wird vollständig online durchgeführt und erfordert keine vorherige Registrierung. Direkt im Anschluss erhalten Teilnehmer einen individuellen Report, der den aktuellen Reifegrad beschreibt, Stärken und Schwachstellen aufzeigt und konkrete Handlungsempfehlungen liefert. Ergänzt wird die Auswertung um Hinweise, wie sich Potenziale für Effizienzsteigerungen und Innovationen erschließen lassen. Durch den geringen Zeitaufwand und die sofortige Rückmeldung eignet sich der AI Readiness Check besonders für Unternehmen, die schnell und unkompliziert ein Bild ihrer Ausgangslage gewinnen und weitere Schritte planen wollen.

TÜV AI Readiness Assessment: Hybrid, professionell, umfassend

Für Unternehmen, die ihre KI-Aktivitäten im Lichte strenger regulatorischer Anforderungen prüfen wollen, bietet der TÜV ein umfassendes AI Readiness Assessment an. Anders als Online-Selbsttests ist dieser Check ein professionelles Prüf- und Analyseverfahren, das durch externe Auditoren durchgeführt wird. Angelegt ist er als hybrides Verfahren: Die erste Datenerhebung kann weitgehend online erfolgen. Unternehmen fordern dazu einen nicht online einsehbaren strukturierten Fragenkatalog an, den sie dann digital ausfüllen. Sie laden relevante Unterlagen hoch und führen gegebenenfalls erste Videointerviews mit den Auditoren. Der kostenpflichtige Kern der Analyse findet anschließend in direkter Zusammenarbeit mit dem TÜV statt – entweder vor Ort oder in Remote-Sitzungen. Gerade bei komplexen Infrastrukturen, Hochrisiko-Anwendungen oder sicherheitskritischen Systemen sind zudem Vor-Ort-Prüfungen sinnvoll, um die reale Umsetzung und gelebte Praxis zu bewerten.

Das Ergebnis des TÜV AI Readiness Assessment ist ein ausführlicher Bericht mit einer detaillierten Lückenanalyse und priorisierten Handlungsempfehlungen. Unternehmen erhalten nicht nur eine klare Roadmap für die Optimierung ihrer KI-Systeme, sondern auch eine belastbare Grundlage für Zertifizierungen und Investorengespräche. Auf Wunsch kann ein Zertifikat ausgestellt werden, das die Einhaltung bestimmter Qualitäts- und Governance-Standards bestätigt. Diese Form des Assessments ist aufwendiger und kostenpflichtig, bietet dafür aber ein Maß an Tiefe und Verlässlichkeit, das mit reinen Online-Checks nicht erreicht wird.

KI-Assessment von PwC: Ganzheitlich und strategisch in drei Varianten

Das Assessment der Unternehmensberatung PwC ist prüft nicht nur technische Voraussetzungen, sondern setzt starke Akzente bei Führung, Kulturwandel, Governance und nachhaltigem Geschäftsnutzen durch KI. Die Ergebnisse liefern Unternehmen eine Standortbestimmung und gezielte Entwicklungsfelder. PwC bietet vor allem drei Assessment-Services an:

- AI Leadership Maturity Assessment: Unternehmen nehmen direkt online eine strukturierte Selbstbewertung (in englischer Sprache) vor, die gezielt die KI-Bereitschaft und die Potenziale für die Unternehmensführung bewertet.

- Responsible AI Validation Engine (RAIVE): Spezial-Assessment für Unternehmen, die ihre KI-Anwendungen auf verantwortungsvolle Nutzung und regulatorische Anforderungen prüfen wollen. RAIVE beginnt mit einer kurzen Selbstbewertung, bevor vertiefte Analysen mit PwC erfolgen

- AI Act Readiness Questionnaire: Extra Fragebogen zur Unternehmens-Readiness im Hinblick auf den EU AI Act, ergänzt von einem Whitepaper

Individuelle Readiness-Checks gibt es von einer Reihe von Beratungshäusern, darunter MaibornWolff, esentri, Althammer & Kill und mindsquare. Meist erfolgen diese im Rahmen von Workshops und Interviews. Neben der technischen Infrastruktur und der Daten-Basis wird auch die Unternehmenskultur, das Change-Management und die Strategie analysiert. Am Ende stehen oft konkrete Handlungsempfehlungen und Roadmaps.

Die Grenzen der Readiness-Checks

So nützlich die Online-Checks als erster Schritt auch sind, so klar liegen auch ihre Grenzen auf der Hand. Online-Checks sind immer nur eine Momentaufnahmen und basieren auf Selbsteinschätzungen. Sie können technologische oder organisatorische Schwächen nur so weit erkennen, wie diese in den Fragen abgebildet sind – und sie ersetzen keine fundierte technische Prüfung. Ein hoher Readiness-Grad garantiert deshalb nicht per se den Erfolg einzelner späterer KI-Projekte. Marktbedingungen, Use Cases und Umsetzung sind entscheidend.

Selbst tiefgehende Assessments wie des TÜV können nur Lücken aufzeigen und Handlungsempfehlungen geben, die eigentliche Umsetzung bleibt aber Aufgabe des Unternehmens. Ohne begleitende Maßnahmen und regelmäßige Wiederholung droht der Erkenntnisgewinn zu versanden.

Der größte Nutzen von Readiness-Checks entfaltet sich, wenn sie nicht als einmalige Pflichtübung verstanden werden, sondern als Bestandteil einer kontinuierlichen KI-Strategie. Ein sinnvoller Weg ist, zunächst einen niederschwelligen Online-Check wie den KIRC oder das encurio-Tool zu nutzen, um schnell ein erstes Lagebild zu gewinnen. Darauf aufbauend können vertiefende Analysen folgen – etwa branchenspezifische Workshops oder ein TÜV-Assessment – um konkrete Maßnahmen zu planen und regulatorische Anforderungen abzusichern. Da sich Technologien, Märkte und gesetzliche Rahmenbedingungen dynamisch verändern, sollte die Überprüfung der eigenen KI-Bereitschaft in regelmäßigen Abständen wiederholt werden.

Geplante Anpassung und Entschärfungen

Der AI Act wurde im Juli 2024 verabschiedet und trat am 1. August 2024 in Kraft. Für „High-Risk“-KI-Systeme warten Übergangsfristen; ihre vollständige Durchsetzung war ursprünglich bis August 2026 vorgesehen. Vor dem Hintergrund der wirtschaftlichen und politischen Krisenlage wurde auf EU-Ebene kürzlich ein Paket an Maßnahmen vorgestellt, das es den Unternehmen erleichtern soll, mit der KI-Regulierung umzugehen. Am 19. November hat die EU-Kommission Vorschläge präsentiert, mit denen der AI Act und andere digitale Regelwerke gestrafft und angepasst werden sollen. Das „Digital Omnibus Regulation“-Paket zielt darauf ab, „Bürokratie abzubauen“ und die Anwendung des AI-Gesetzes praxisnäher zu gestalten:

- Die Pflichten für „High-Risk“-KI-Systeme sollen teils verzögert werden: Die Anwendung bestimmter Vorschriften hängt künftig davon ab, dass die Kommission vorher harmonisierte Standards einführt. Damit verschieben sich Fristen — zum Beispiel auf Ende 2027 bzw. August 2028.

- Für kleinere und mittlere Unternehmen (KMU/SME) soll der Gesetzesrahmen vereinfacht werden — zum Beispiel durch weniger aufwendige Dokumentationspflichten.

- Die Aufsichts- und Governance-Strukturen sollen bei Systemen auf Basis von GPAI (Allzweck-KI) zentraler organisiert werden — weniger Fragmentierung, mehr Übersichtlichkeit.

Kurz: Unternehmen bekommen mehr Zeit und Flexibilität, sich auf die Vorschriften einzustellen — das reduziert kurzfristig den Druck. Damit einhergehend soll das Gesetz praxisnäher und umsetzbarer werden — mit weniger Belastungen für KMU, bei gleichzeitig klareren Regeln. Für Anbieter von generativen KI-Modellen und komplexen KI-Systemen soll die Rechtslage transparenter und vorhersehbarer werden.

Fazit & Ausblick

Eine ständige Überprüfung der eigenen KI-Strategien ist schon aus rechtlichen Gründen notwendig. Vieles ist noch im Fluss, auch und gerade, was den EU AI Act angeht. Die EU-Kommission hat Mitte Juli den von einer unabhängigen Expertenkommission erstellten „GPAI Code of Practice“ veröffentlicht. Er soll Klarheit darüber schaffen, wie die Anforderungen des AI Act für Allzweck-KI-Modelle (GPAI-Modelle) umgesetzt werden müssen, die besonders leistungsfähig und vielseitig einsetzbar sind und etwa die technologische Grundlage für Anwendungen wie ChatGPT bilden.

Der Digitalverband Bitkom sieht darin die Chance, Rechtssicherheit für die Entwicklung von KI in Europa zu schaffen. Gegenüber ersten Entwürfen sei der Code vereinfacht worden und orientiere sich stärker am Gesetzestext, so dass er in den Unternehmen besser anzuwenden sei. „Damit der AI Act wirklich praxistauglich umgesetzt werden kann, müssen aber sehr umfassende, aber vage formulierte Prüfpflichten nachgebessert und der bürokratische Aufwand deutlich reduziert werden. Der Code of Practice darf keine Bremse für den KI-Standort Europa werden“, fordert Susanne Dehmel, Mitglied der Bitkom-Geschäftsleitung.

Kritisch sieht der Bitkom die verschärfte Verpflichtung zur offenen Risikosuche bei sehr leistungsstarken KI-Modellen, der „open-ended risk identification“. Das bedeutet, dass Unternehmen kontinuierlich nach potenziell denkbaren Risiken suchen müssen, die ein KI-Modell verursachen könnte. „Zusammen mit uneindeutig definierten Grundrechtsrisiken und gesellschaftlichen Risiken, bei denen häufig kaum etablierte Methoden zur Identifikation und Bewertung existieren, entsteht neue Rechtsunsicherheit für europäische KI-Anbieter“, warnt Dehmel.

Bleibt abzuwarten, wie erfolgreich die derzeit laufenden Anstrengungen sind, die Regulierung für die KI zu vereinfachen und unnötige Hürden zu beseitigen.

Wissen wird Pflicht: KI-Schulung in der AI Genie Academy

Der 2025 in Kraft getretene EU AI Act verpflichtet Organisationen, ihre Mitarbeitenden bis Mitte 2026 nachweislich in Grundlagen der Künstlichen Intelligenz zu schulen. Genau hier setzt die AI Genie Academy an. Besonders relevant ist Art. 4 Abs. 3, der von den Beschäftigten Wissen über Funktionsweise, Grenzen und rechtliche Implikationen von KI einfordert. Die AI Genie Academy der Ebner Media Group unterstützt Unternehmen mit praxisnahen On-Demand-Schulungen. Zwei zertifizierte Kurse („AI Literacy Essentials“ und „AI Literacy Advanced“) ermöglichen einen schnellen, rechtskonformen Einstieg und vertiefendes Know-how. Zum Start gibt es ein Einführungsangebot: Essentials – 29 € statt 49 €, Advanced – 34 € statt 89 €.

(Bild: Ebner Media Group)

(Bild: Ebner Media Group)

„Chancen für Europa durch klare Regeln“

Seit dem 2. August 2025 greifen die Regeln des EU AI Act. Unternehmen stehen damit vor der Herausforderung, ihre Datenstrategie zu überprüfen – und gleichzeitig vor der Chance, durch klare Regeln Innovation sicher und verantwortungsvoll voranzutreiben. Ein Kommentar von Johannes Pape, Head of AI EMEA & LATAM bei NetApp.

Der viel diskutierte EU AI Act wird Realität: Bereits seit Februar 2025 gelten die Vorgaben für die Kompetenz von KI-Betreibern sowie das Verbot bestimmter KI-Systeme und KI-Praktiken. Am 2. August 2025 ist es ernst geworden für die Unternehmenswelt: Die Regeln des europäischen Gesetzes über künstliche Intelligenz werden angewendet, und bei Verstößen drohen Geldbußen und Sanktionen. Die Wirtschaftswelt hat bisher mit sehr gemischten Gefühlen auf das europäische KI-Gesetz geblickt. Eine Deloitte-Umfrage im Herbst 2024 ergab, dass mehr als die Hälfte der befragten Unternehmen denkt, ihre Innovationsmöglichkeiten im Bereich KI werden durch die Regulierung eingeschränkt. Weniger als 20 Prozent glauben daran, dass sich der AI Act dahingehend positiv auswirken wird.

Erfolgversprechend: risikobasierter Ansatz

Doch die Sorgen, dass die neuen Regelungen die KI-Innovationskraft beeinträchtigen können, sind größtenteils unberechtigt. Stattdessen ist die Führungsrolle der EU bei der Erarbeitung von Rechtsvorschriften für den KI-Einsatz zu begrüßen. Sie verabschiedete im Juni 2024 die weltweit ersten verbindlichen Regelungen zur künstlichen Intelligenz. Damit hat sie sich als erste staatliche Institution weltweit der wichtigen Aufgabe gestellt, einen Rahmen für die verantwortungsvolle Nutzung von KI zu schaffen und somit das Vertrauen in die Technologie zu stärken.

Der risikobasierte Ansatz, demzufolge Unternehmen ihre KI-Systeme nach klassifizierten Risiken einordnen und passende Maßnahmen ergreifen müssen, ist dafür der richtige Weg. Er wird die Industrie langfristig gesehen bei der Implementierung von KI in Unternehmensprozesse unterstützen, anstatt sie – wie viele befürchten – zu behindern.

Der risikobasierte Ansatz der EU verpflichtet Unternehmen dazu, dafür zu sorgen, dass alle Daten ordnungsgemäß kategorisiert und nur wie erlaubt verwendet werden. Dies zu bewältigen, ist für Unternehmen ein äußerst komplexes Unterfangen – schon angesichts der riesigen Datenmengen, die täglich generiert werden. Diese Daten sind sowohl ein Produkt als auch ein Vermögenswert. Mit dem anhaltenden Höhenflug von KI wird ihr Status in den Unternehmen kontinuierlich weiter an Bedeutung gewinnen.

Unternehmenseigene Daten schützen

Um das Beste aus der KI herauszuholen und dabei die Compliance zu wahren, ist es von zentraler Bedeutung, die richtigen Schutzmaßnahmen für unternehmenseigene Daten zu ergreifen. Nur so lassen sich die Interessen des Gesetzgebers, der Bürger und der Wirtschaft vereinen. Organisationen, die Data Governance ins Zentrum ihrer Datenstrategie rücken, können die Vorteile dieser neuen Technologie optimal und gesetzeskonform nutzen. Darüber hinaus spielt auch Data Sovereignty eine wichtige Rolle, denn Firmen und Institutionen müssen darauf achten, dass ihre Daten trotz Cloud-Infrastruktur im Land bleiben und lokalen Compliance-Anforderungen entsprechen.

Die Datengrundlage entscheidet, ob Unternehmen ihren Compliance-Pflichten nachkommen und KI gesetzeskonform nutzen können. Daten sowie ihre Speicherung und ihr Einsatz nehmen eine herausragende Stellung im AI Act ein (…). Die Anwendung des neuen EU-Gesetzes wird daher zum Anlass für Unternehmen, ihr Datenmanagement gründlich auf die Probe zu stellen und auch zu optimieren.

Die Regulierungsinitiativen der EU und der Mitgliedstaaten tragen im Idealfall dazu bei, dass im europäischen Wirtschaftsraum eine solide Grundlage für ein wettbewerbsfähiges Ökosystem entsteht, indem sie Unternehmen dabei helfen, ihre Daten proaktiv und intelligent zu managen und zu schützen.

Der EU AI Act markiert einen wichtigen Schritt hin zu einem vertrauenswürdigen und verantwortungsvollen Umgang mit künstlicher Intelligenz. Er schafft die Voraussetzungen für eine innovationsfreundliche Regulierung, die Unternehmen nicht ausbremst, sondern ihnen Orientierung gibt – gerade im Hinblick auf den Umgang mit Daten. Entscheidend ist, dass die Anforderungen praxistauglich bleiben und Unternehmen nicht durch übermäßige Bürokratie ausgebremst werden.